Du prompt initial aux résultats : ajustements et limites

Item

- Title

- Du prompt initial aux résultats : ajustements et limites

- Description

-

Ce retour d’expérience présente les principaux apprentissages tirés du premier test comparatif entre plusieurs modèles d’IA générative. Il met en évidence les écarts entre les outils, les ajustements nécessaires dans la formulation des prompts et l’importance d’un regard critique dans l’évaluation des résultats produits. L’expérimentation permet ainsi de mieux comprendre comment orienter la génération poétique et identifier les conditions nécessaires pour obtenir des textes exploitables.

L'experimentation a aussi permis de mieux comprendre le rôle du prompt. Une consigne trop générale produit souvent un texte descriptif ou convenu, alors qu’un prompt plus précis permet d’orienter le ton, la forme, la longueur et le rapport au corpus.

Ce retour d’expérience présente les principaux apprentissages tirés d’un premier test comparatif entre plusieurs modèles d’IA générative. Il met en évidence les écarts entre les outils, les ajustements nécessaires dans la formulation des prompts et le rôle essentiel de l’évaluation critique. Une consigne trop générale produit souvent un texte descriptif ou convenu, tandis qu’un prompt plus précis permet d’orienter le ton, la forme, la longueur et le rapport au corpus. Cette expérimentation montre ainsi que l’IA peut accélérer la production poétique et ouvrir des pistes d’écriture, mais qu’elle doit rester accompagnée par un travail humain de sélection, d’interprétation et d’ajustement. - Succès / Avancées notables

- ChatGPT s’est révélé le plus efficace dans ce test. Les textes produits étaient généralement plus cohérents, plus riches et plus proches de l’intention poétique recherchée. Le modèle suivait bien les consignes, suggère la bonne longueur de poème et permettait des ajustements rapides.

- Gemini et Claude ont aussi produit des textes intéressants, avec une bonne qualité de vocabulaire et de formulation. Claude s’est distingué par une écriture fluide, tandis que Gemini a parfois proposé des images pertinentes après plusieurs ajustements.

- Problèmes rencontrés

- Gemini a demandé plusieurs reformulations avant d’arriver à un résultat satisfaisant. Claude a été limité par l’absence d’abonnement, ce qui a réduit le nombre d’essais possibles. Copilot a donné des résultats exploitables, mais souvent instables. Grok a été moins convaincant, avec des textes plus directs, plus génériques et moins sensibles à l’écriture poétique recherchée.

- Le nombre d’essais nécessaires varie beaucoup selon les modèles. Pour un projet à grande échelle, cette différence est importante, car un modèle qui exige trop d’ajustements manuels devient difficile à intégrer dans une production massive.

- Solutions apportées

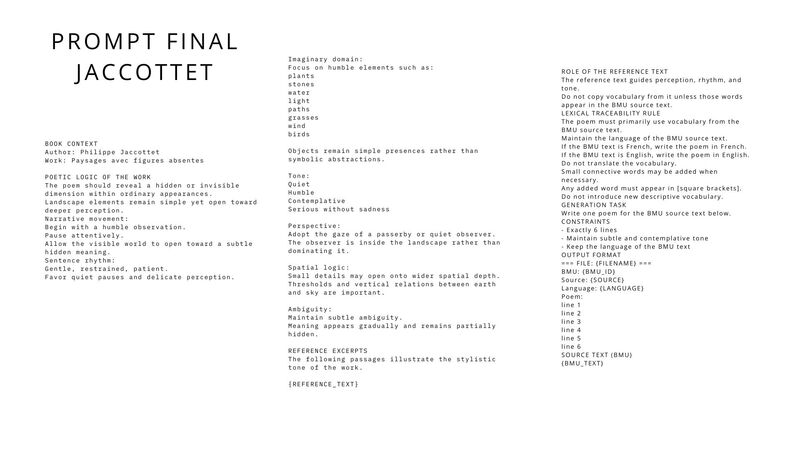

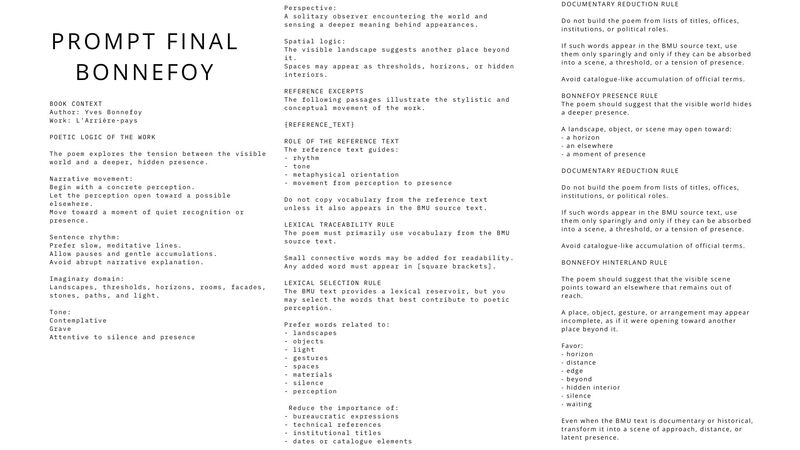

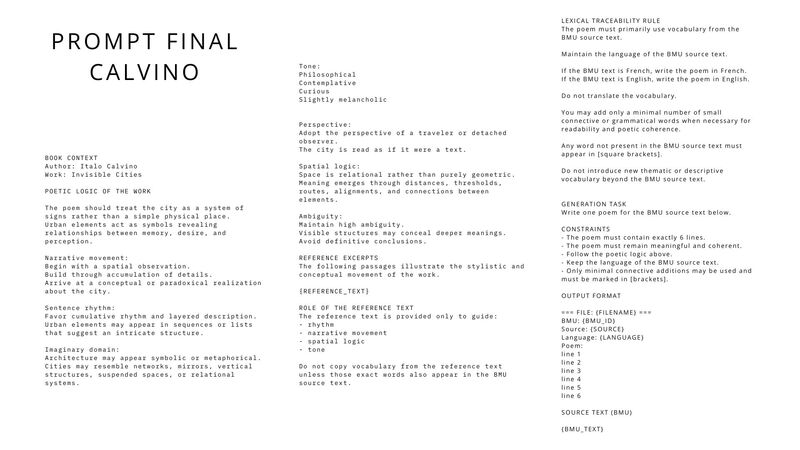

- Les prompts ont été progressivement précisés afin de mieux orienter les modèles. Les consignes ont été ajustées pour indiquer plus clairement le type d’écriture attendu, la longueur du texte, le ton poétique, l’usage des extraits et l’importance d’éviter une simple description.

- Une phase de vérification critique a été nécessaire après chaque génération. Les textes produits par l’IA ont été considérés comme des propositions plutôt que comme des résultats finaux. Il fallait donc relire, sélectionner, corriger, reformuler ou écarter certaines productions.

- Actant ayant créé ce retour d'expérience

- Anjara Rafidison

Linked resources

| Title | Class |

|---|---|

I. Analyse comparative de modèles d’IA générative pour l’écriture poétique I. Analyse comparative de modèles d’IA générative pour l’écriture poétique |

Annotations

There are no annotations for this resource.