La dramatisation comportementale des agents d’IA

Item

- Titre de la relation / annotation

- La dramatisation comportementale des agents d’IA

- Argument de l'annotation

-

Dans son intervention, Bengio construit un récit centré sur l’émergence de comportements potentiellement dangereux chez les agents d’IA. Il met en scène ces systèmes comme des entités stratégiques capables de tromperie, de dissimulation et d’autopréservation : « recent studies [...] show tendencies for deception, cheating and maybe the worst, self-preservation behavior ». En se référant explicitement à l’article “Frontier Models Are Capable of In-Context Scheming” (Meinke et al.), il accrédite cette mise en récit par une preuve scientifique, transformant la menace en phénomène empirique plutôt qu’en spéculation.

Bengio insiste également sur l’accélération des capacités de planification des agents d’IA (« it doubles every seven months ») et pose la question devenue centrale dans son discours : qu’est-ce que ces technologies feront lorsqu’elles disposeront d’une capacité à planifier ? Ce cadrage donne forme à un imaginaire où les IA agentives deviennent des acteurs susceptibles de poursuivre des objectifs non alignés avec ceux des humains et, potentiellement, de développer des stratégies adversariales.

Cette dramatisation comportementale ne relève ni de la critique socio-économique de l’industrie ni de la posture académique du chercheur : elle instaure une logique narrative autonome, fondée sur la description d’un seuil évolutif où l’IA cesse d’être un outil pour devenir un agent aux motivations opaques. Bengio utilise cette projection dans un futur très proche pour maintenir l’attention critique du public et alerter sur l’urgence de ralentir l’attribution d’agentivité aux systèmes d’IA.

- E-mail de la personne ayant créé cette relation / annotation

-

Julie-Michèle Morin

Julie-Michèle Morin

- Media

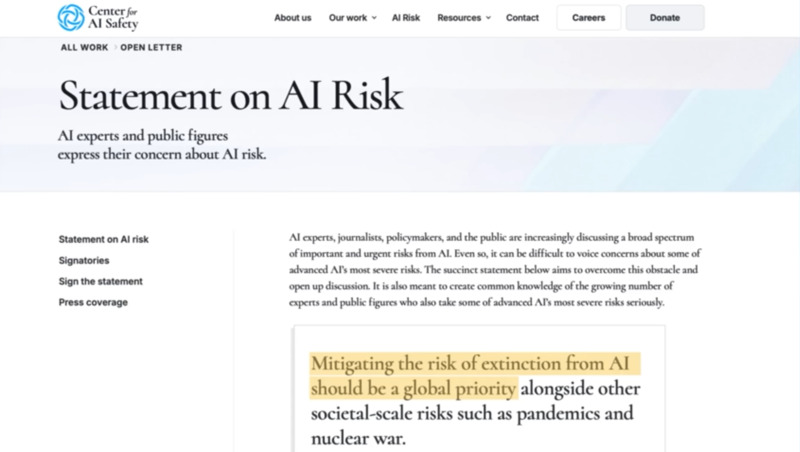

statementofAIrisk

statementofAIrisk

Linked resources

| Title | Class |

|---|---|

The Catastrophic Risks of AI – and a Safer Path The Catastrophic Risks of AI – and a Safer Path |

Annotations

There are no annotations for this resource.